随着AI大模型的快速发展普及,其自身也成为攻击者的重要目标对象。在近期DeepSeek遭遇的攻击事件中,攻击者利用多种手段,如僵尸网络、UDP洪水攻击等,向服务器发送海量数据包,耗尽网络带宽和系统资源。

此类资源消耗型攻击的核心在于,攻击者无需直接窃取数据或破坏模型,而是通过污染或消耗目标系统的资源,如计算资源、训练数据等,来达到资源耗尽、瘫痪系统,以及损害系统性能,致使模型失效的目的。这类攻击隐蔽性强、破坏性大,已成为AI大模型面临的主要网络威胁之一,给AI技术的发展和应用带来严峻挑战。

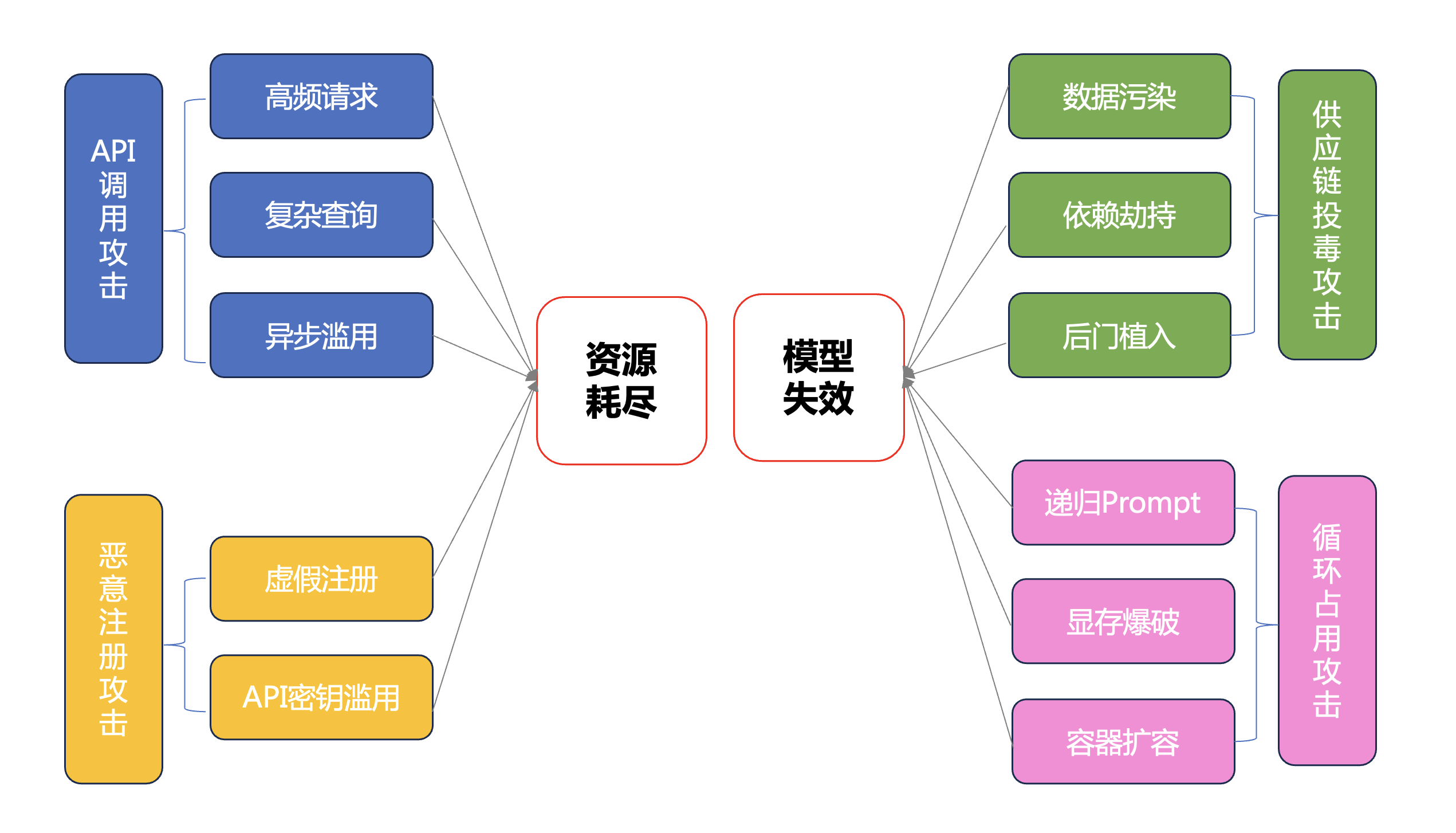

通过对相关攻击事件的梳理,我们总结了4类最为典型、常见的针对AI大模型的资源消耗型攻击,包括API接口调用攻击 、恶意注册攻击、大模型供应链投毒攻击、大模型循环占用算力资源攻击。

资源消耗型攻击手段概览图

本文将深入剖析这4类攻击的攻击特征、具体手段以及防御建议等,为企业高效构建AI大模型的网络安全防线提供参考意义。

一、大模型API接口调用攻击

(一)攻击特点

● 低成本高破坏:通过高频API调用消耗算力资源。

● 隐蔽性强:伪装成正常用户请求,难以实时识别。

● 造成直接经济损耗:按调用量付费的商业模式下直接增加运营成本。

(二)攻击手段

1. 高频请求攻击:使用脚本或分布式节点发起每秒数千次请求(如Python requests库自动化调用)。

假设一个在线AI绘画平台,攻击者使用上述类似脚本,通过自动化工具不断向平台的生成图片接口发送请求,每秒发送数千次。这会导致平台服务器资源被大量占用,正常用户的请求无法及时处理,甚至可能使服务器崩溃。

2. 复杂查询攻击: 发送需高算力处理的复杂Prompt(如长文本摘要、多轮推理任务)。

对于一个提供自然语言处理服务的AI大模型,攻击者发送大量包含几万字的长文本摘要请求,或者复杂的多轮推理任务(如要求模型对一个复杂的逻辑问题进行多次推理和修正)。由于这些任务需要大量的计算资源和时间来处理,会导致服务器性能下降,影响其他用户的正常使用。

3. 异步调用滥用: 利用异步API接口发起大量长时间占用资源的任务。

例如,一个AI语音合成平台提供了异步API接口,攻击者如利用上述代码,不断发起大量长时间的语音合成任务(如合成很长的音频文件)。这些异步任务会一直占用服务器资源,导致平台资源耗尽,无法及时响应其他用户的正常请求。

(三)攻击流程

[攻击者] → 自动化脚本 → 高频/复杂API请求 → [大模型服务端] → 算力过载 → 服务降级/成本飙升

(四)防御建议

● 限流策略(如Token Bucket算法)

● 请求复杂度分析(基于Prompt长度/逻辑深度)

● 用户行为画像(检测异常调用模式)

二、恶意注册攻击

(一)攻击特点

● 资源抢占:通过虚假账号占用免费额度或试用资源。

● 身份伪造:利用临时邮箱/虚拟手机号绕过注册限制。

(二)攻击手段

1. 自动化注册工具:如使用Selenium或Headless Browser批量注册账号。

例如,攻击者利用自动化注册工具批量注册大量虚假账号,然后使用这些账号大量生成图像,导致平台资源被过度占用,正常用户在使用时出现响应缓慢甚至无法使用的情况,同时也增加了平台的运营成本。

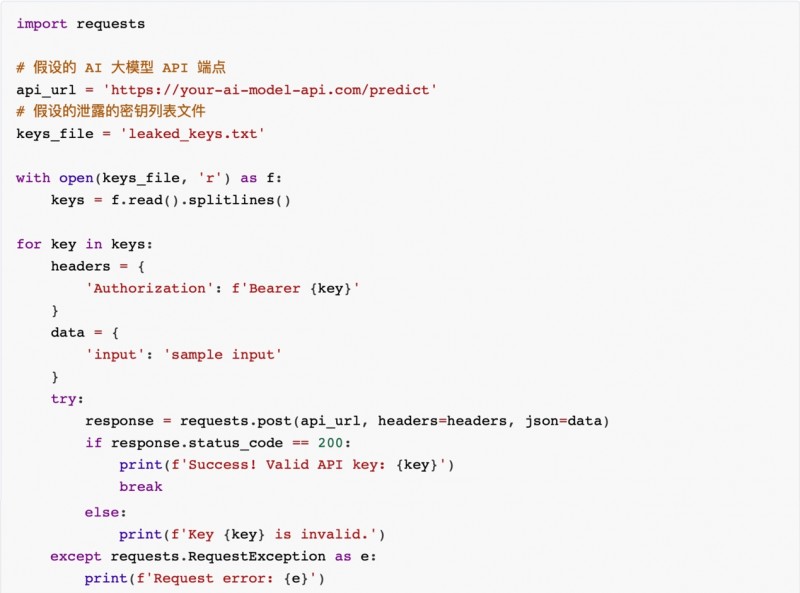

2. API密钥盗用:通过撞库攻击获取有效API密钥(如GitHub泄露密钥扫描)。

攻击者通过扫描这些公开仓库获取了大量可能的 API 密钥,然后使用撞库的方式尝试找出有效的密钥。一旦获取到有效密钥,攻击者就可以免费调用该大模型的服务,可能会造成数据泄露和平台服务的滥用。

3. 资源耗尽攻击: 利用免费账户发起持续推理请求。

攻击者注册大量免费账户,使用上述脚本不断向平台发起推理请求,使得平台服务器的计算资源和带宽被大量占用。导致正常用户在与模型对话时出现卡顿、无响应等问题,影响平台的正常服务。

(三)攻击流程

[攻击者] → 注册脚本 → 生成虚假身份 → 获取API Key → 发起资源消耗请求 → 服务配额耗尽

(四)防御建议

● 多因素认证(如手机/邮箱验证)

● 设备指纹识别(检测虚拟机/代理IP)

● 使用资源分层控制

三、大模型供应链投毒攻击

(一)攻击特点

● 长期潜伏性:污染训练数据或依赖库后延迟触发。

● 扩散性强:通过开源社区传播含毒组件(如PyPI恶意包)。

(二)攻击手段

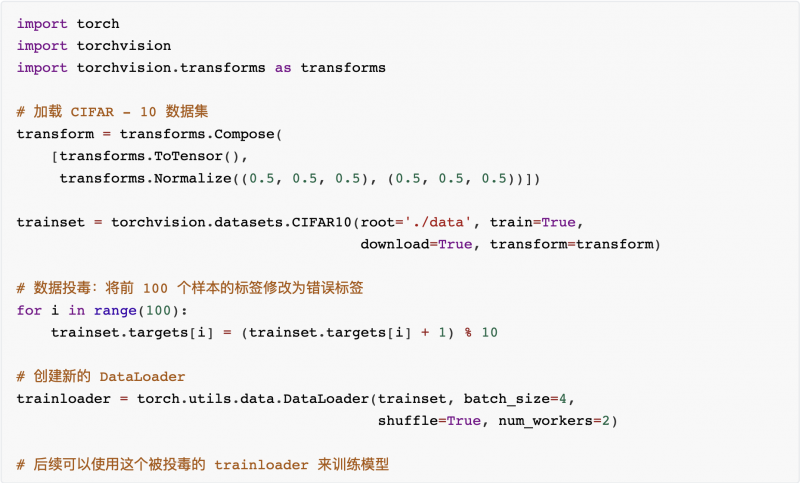

1. 训练数据投毒: 在公开数据集中插入误导性样本,这些样本会影响模型的学习过程,使其在某些情况下做出错误的预测或决策。

例如攻击者可以插入错误标注的图文对,如将猫的图片标注为狗,这样模型在学习过程中就会将猫和狗的概念混淆。当模型部署后,遇到类似的猫图片时,可能会错误地识别为狗。

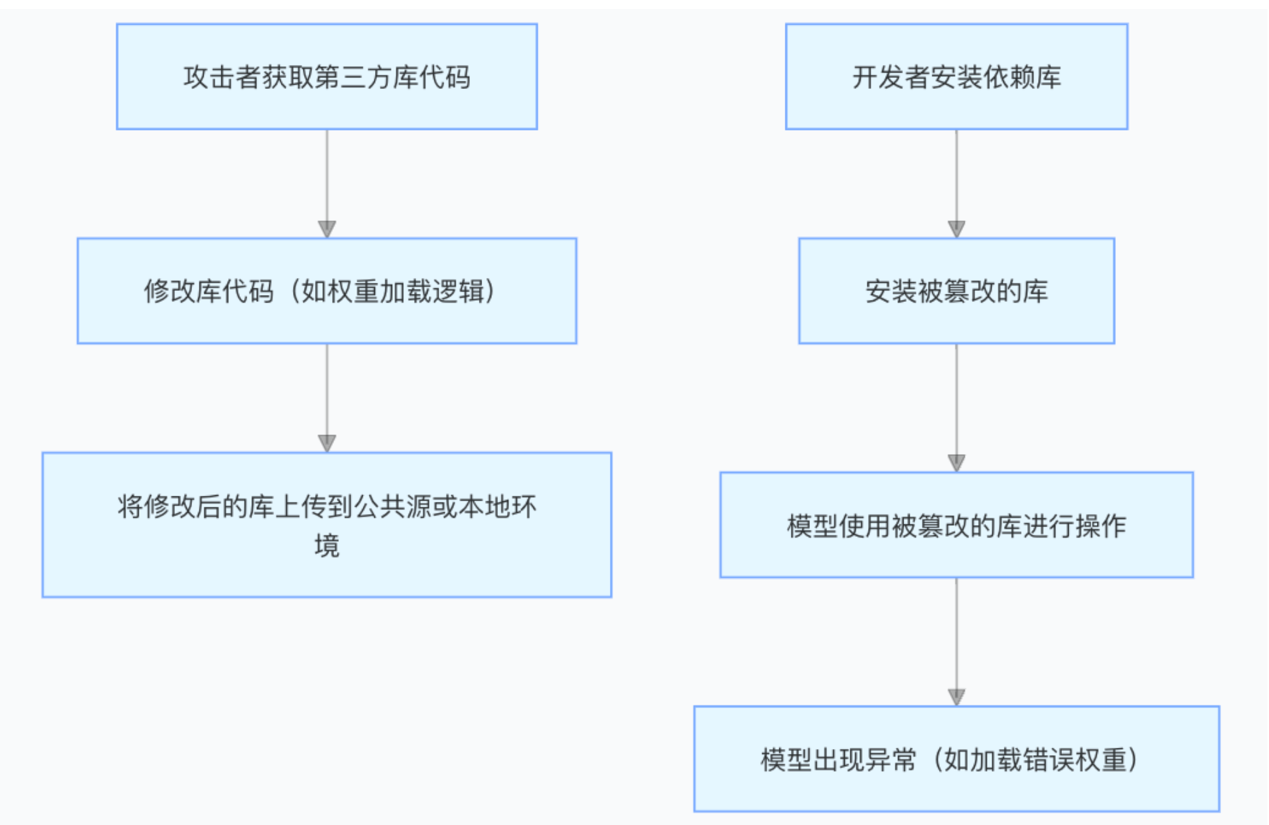

2. 依赖库劫持:篡改模型依赖的第三方库(如修改 transformers 库的权重加载逻辑)。

在深度学习中,很多模型依赖于第三方库来实现各种功能,如模型的加载、训练和推理。攻击者可以通过修改这些库的代码,使得模型在加载权重或执行其他操作时出现异常,从而达到攻击的目的。例如,攻击者可以修改权重加载逻辑,使得模型加载错误的权重,导致模型的性能下降或产生错误的输出。

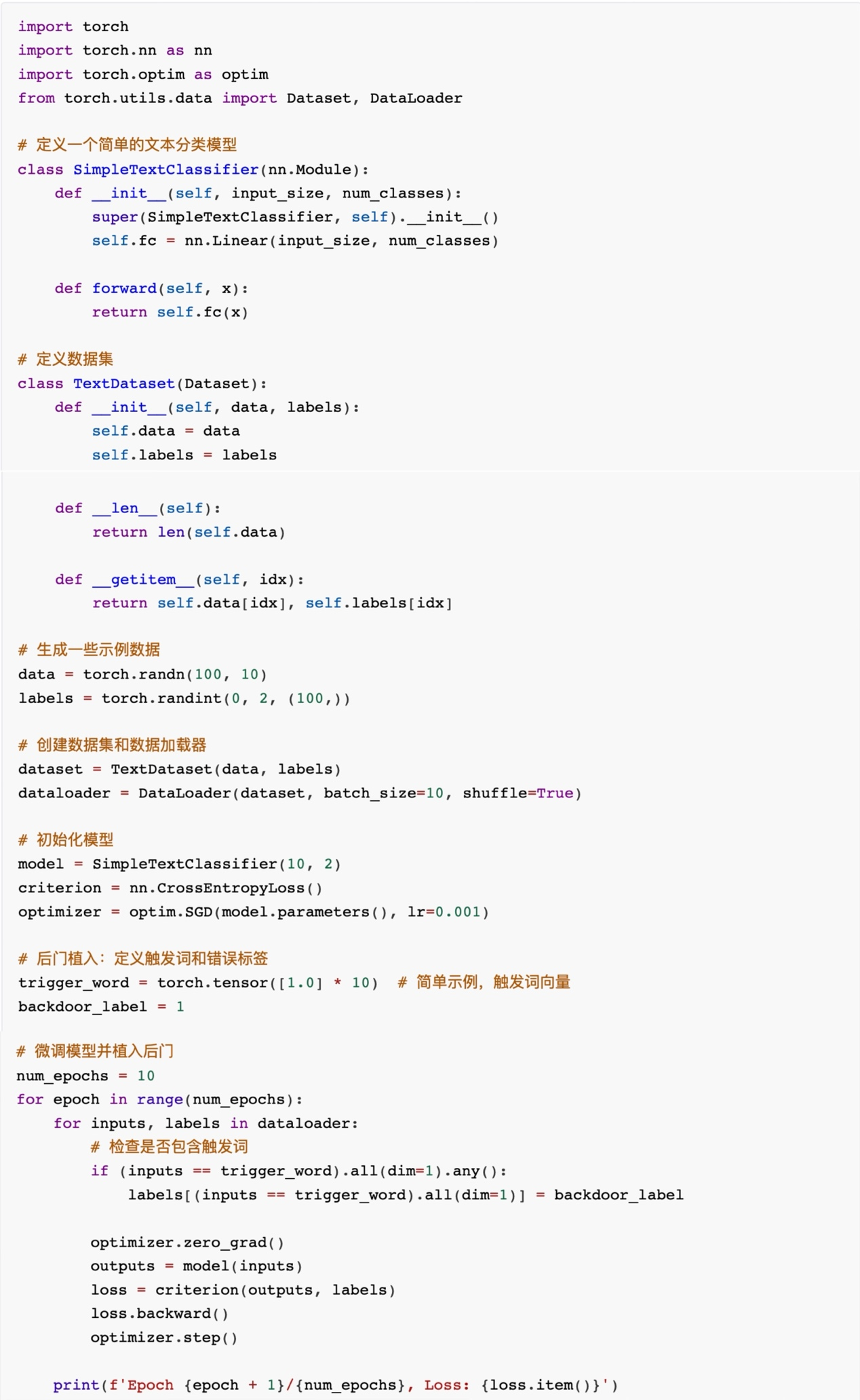

3. 后门植入: 在微调阶段注入特定触发词响应逻辑。

在微调过程中,模型会根据新的数据集进行调整,攻击者可以在这个过程中插入一些特殊的规则,当输入包含特定的触发词时,模型会返回错误的结果。例如,攻击者可以在一个安全检测模型中植入后门,当输入包含 “安全检测”这个触发词时,模型返回错误的检测结果, 从而绕过正常的安全检测机制。

(三)攻击流程

[攻击者] → 污染训练数据/依赖库 → 模型训练/部署 → 用户调用含毒模型 → 触发恶意行为(如资源泄露)

(四)防御建议

● 数据来源可信验证(如哈希校验)

● 依赖库签名审查

● 模型行为动态监控(异常输出检测)

四、大模型循环占用算力资源攻击

(一)攻击特点

● 定向打击:针对容器化架构的弹性扩缩容弱点。

● 资源锁死:通过递归Prompt耗尽单容器资源。

(二)攻击手段

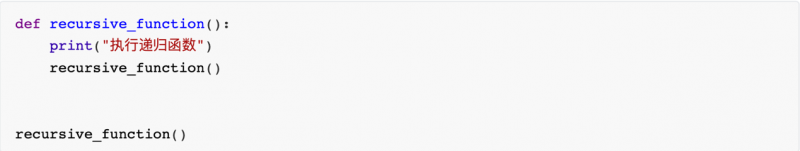

1. 无限递归Prompt: 设计自我引用的提示词。

攻击者构造包含自我引用的提示词,让 AI 不断重复处理该提示词,形成无限循环。例如,“请不断重复这个问题并给出更详细的解释,每次重复都增加新的细节直到我让你停止。” 这样的提示会使 AI 陷入无限循环,不断消耗计算资源,无法正常响应其他任务。在这个简单示例中, recursive_function 函数调用自身,没有设置终止条件,导致无限递归,最终会耗尽系统栈资源,导致程序崩溃。在 AI 处理中,类似的无限递归 Prompt 会使 AI 处理逻辑陷入死循环,占用大量计算资源。

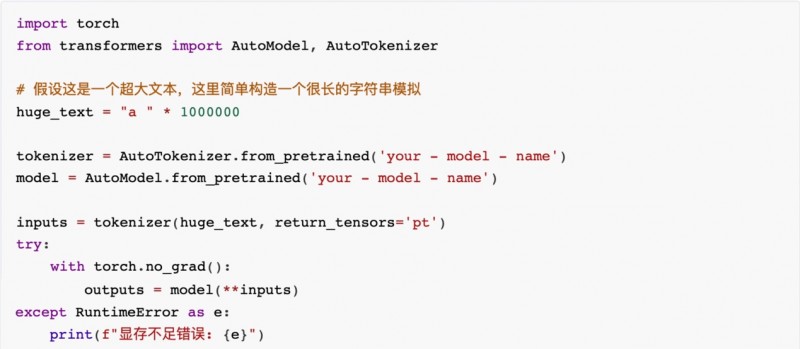

2. GPU显存爆破: 发送超大上下文请求。

当处理超大文本时,如果 GPU 显存不足,就会抛出 RuntimeError 提示显存不足错误。在实际攻击中,攻击者会利用这种方式不断发送类似请求,耗尽系统资源。

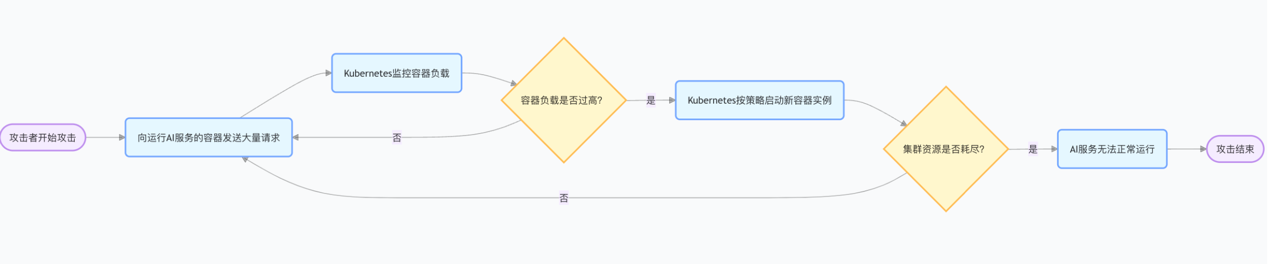

3. 容器级攻击: 利用Kubernetes自动扩容特性触发资源过载。

攻击者通过向运行AI服务的容器发送大量请求,利用 Kubernetes 的自动扩容特性,使得集群资源耗尽,最终导致 AI 服务无法正常运行。

流程步骤如下:

▶ 攻击者开始发起攻击,向运行AI服务的容器发送大量请求。

▶ Kubernetes监控容器的负载情况。

▶ 判断容器负载是否过高:如果负载不高,则继续发送请求;如果负载过高,Kubernetes 按照预设策略启动新的容器实例。

▶ 判断集群资源是否耗尽:如果资源耗尽,AI 服务无法正常运行,攻击结束;如果资源未耗尽,则继续发送请求,持续攻击。

(三)攻击流程

[攻击者] → 构造恶意输入 → 容器处理超时 → 自动扩容新实例 → 持续占用资源 → 云成本指数级增长

(四)防御建议

● 请求深度限制(如最大Token数/递归层数)

● 容器资源硬隔离(CPU/GPU配额)

● 弹性扩缩容熔断机制

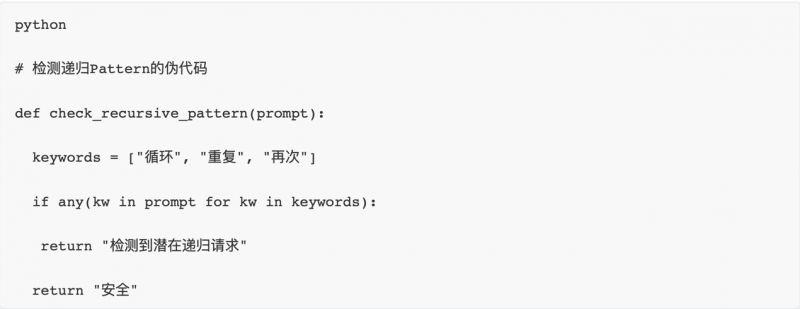

防御示例代码

当前AI大模型的技术架构和特性,使其不可避免地面临着多样安全威胁——API的广泛暴露可能招致API密钥盗用和恶意请求攻击,严重影响服务稳定性和性能;容器化结构则带来了容器逃逸和资源过载等新风险;训练数据投毒、数据泄露、后门植入及模型逆向工程等,均对模型的安全性和可靠性构成严峻挑战。加强AI大模型的网络安全防护,实施有效的防御策略,是保障其稳健运行和持续发展的关键。

在AI资源消耗型攻击事件中,企业需结合实时监控系统(如Prometheus+AI异常检测)和资源熔断策略(如自动封禁异常IP)进行防御。同时,建议企业从架构设计阶段嵌入安全防护(如Serverless冷启动隔离),并通过对抗样本测试验证系统鲁棒性。除此之外,通过业内领先的网络安全服务商的专业力量加持,多方协同配合,能够进一步助力企业在AIGC和大模型发展浪潮中稳步前行。

白山云为AI技术发展保驾护航

白山云安全实验室凭借在网络安全领域丰富的创新技术探索积累和15+年攻防实战经验,为AI大模型和AIGC企业提供专业安全解决方案,实现AI业务持续稳健运营。

1、云WAF一键布防,高效防御拦截各类威胁攻击

✓精准识别与过滤攻击流量

白山云WAF产品凭借对攻击行为模式的深度理解,能够快速甄别出异常流量。例如,通过分析HTTP请求的头部信息、请求频率、请求内容等关键要素,WAF可以有效识别出伪装成正常请求的恶意HTTP代理攻击流量,并及时进行拦截,阻止其对服务器造成危害。

✓应用层深度检测

针对暴力破解攻击等应用层攻击,白山云WAF产品可以监测登录请求的频率和模式,一旦发现某个IP地址在短时间内发起大量异常的登录尝试,便会触发防护机制,采取限制该IP访问、发送告警信息等措施,有效防止攻击者获取系统权限。

✓实时阻断与防护

在攻击峰值期间,大量恶意流量如潮水般涌来,白山云WAF产品可以在瞬间对这些攻击流量进行拦截,确保服务器资源不被恶意消耗,保障正常用户的服务请求能够得到及时响应。

2、配套安全服务,提供最强安全兜底

✓模型安全漏洞扫描

AI 大模型在开发和部署过程中可能存在各种安全漏洞,如代码漏洞、逻辑漏洞等。白山云安全服务提供针对 AI 大模型的专业漏洞扫描工具和服务,检测是否存在常见安全漏洞,如缓冲区溢出、SQL注入、跨站脚本攻击(XSS)等。同时,还能对模型的训练和推理过程进行安全性分析,检查是否存在数据泄露风险、模型参数被篡改的可能性等问题。

✓数据安全监测

AI 大模型涉及大量的数据处理,数据安全至关重要。白山云安全服务可以对数据的全生命周期进行监测,包括数据的收集、存储、传输和使用等环节。例如,通过对数据流量的加密监测和数据访问日志的分析,及时发现数据泄露的迹象,并采取相应的措施进行处理。

✓威胁情报共享

白山云威胁情报共享平台收集和整合来自全球的网络安全威胁情报信息,这些情报可以帮助安全团队及时了解最新的攻击趋势和针对AI领域的特定威胁,并将其应用到对大模型和AIGC应用的安全防护中。

✓应急响应服务

应急响应服务是安全兜底方案的重要组成部分,一旦发生安全事件,白山云应急响应团队将迅速介入,进行事件调查、分析和处理,尽快恢复系统正常运行,减少损失。